Fragen

Das Hintergrundpapier wirft verschieden Fragen auf, die im Zusammenhang mit ChatGPT und anderen Computermodellen zur Sprachverarbeitung diskutiert werden. Einige dieser Fragen sind:

- Wie können wir sicherstellen, dass diese Modelle nicht diskriminierend sind?

- Wie können wir verhindern, dass diese Modelle missbraucht werden, um Falschinformationen zu verbreiten oder Menschen zu manipulieren?

- Wie können wir sicherstellen, dass die Verwendung dieser Modelle transparent und nachvollziehbar ist?

- Welche Auswirkungen haben diese Modelle auf die Arbeitswelt und wie können wir sicherstellen, dass sie nicht zu Arbeitsplatzverlusten führen?

- Wie können wir sicherstellen, dass diese Modelle ethisch verantwortungsvoll eingesetzt werden?

Gibt es auch Antworten?

: Das Hintergrundpapier gibt keine direkten Antworten auf diese Fragen, sondern zielt darauf ab, Fragestellungen abzuleiten, unter denen die Rolle von KI-Modellen zur Sprachverarbeitung weiter beobachtet und untersucht werden kann. Es werden jedoch verschiedene Aspekte diskutiert, die bei der Beantwortung dieser Fragen berücksichtigt werden sollten. Zum Beispiel wird darauf hingewiesen, dass es wichtig ist, die Verwendung dieser Modelle transparent und nachvollziehbar zu gestalten und sicherzustellen, dass sie ethisch verantwortungsvoll eingesetzt werden. Es wird auch betont, dass weitere Forschung notwendig ist, um die Auswirkungen dieser Modelle auf die Gesellschaft besser zu verstehen und um mögliche negative Folgen zu vermeiden.

: Das Hintergrundpapier gibt keine direkten Antworten auf diese Fragen, sondern zielt darauf ab, Fragestellungen abzuleiten, unter denen die Rolle von KI-Modellen zur Sprachverarbeitung weiter beobachtet und untersucht werden kann. Es werden jedoch verschiedene Aspekte diskutiert, die bei der Beantwortung dieser Fragen berücksichtigt werden sollten. Zum Beispiel wird darauf hingewiesen, dass es wichtig ist, die Verwendung dieser Modelle transparent und nachvollziehbar zu gestalten und sicherzustellen, dass sie ethisch verantwortungsvoll eingesetzt werden. Es wird auch betont, dass weitere Forschung notwendig ist, um die Auswirkungen dieser Modelle auf die Gesellschaft besser zu verstehen und um mögliche negative Folgen zu vermeiden.

Welche Anwendungsbereiche werden in dem Papier positiv hervorgehoben?

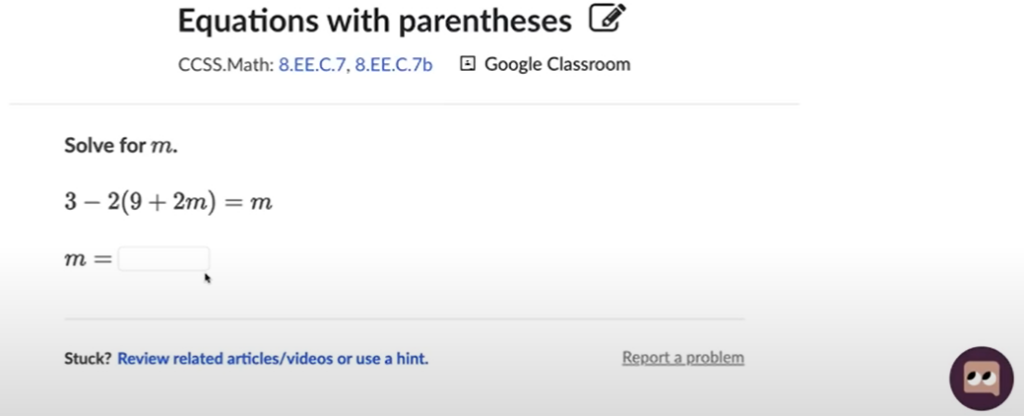

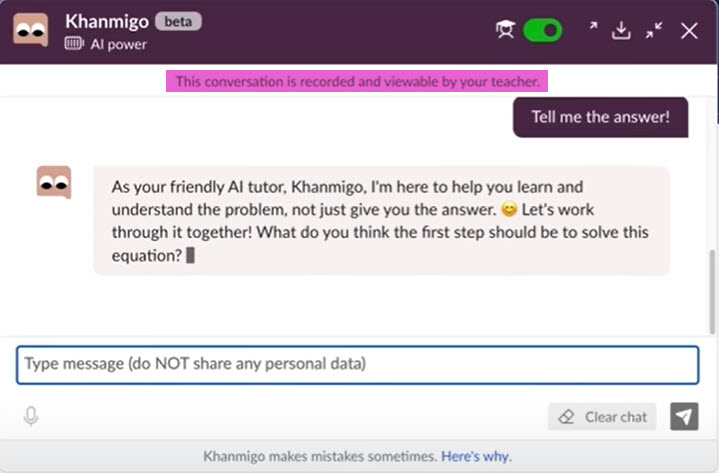

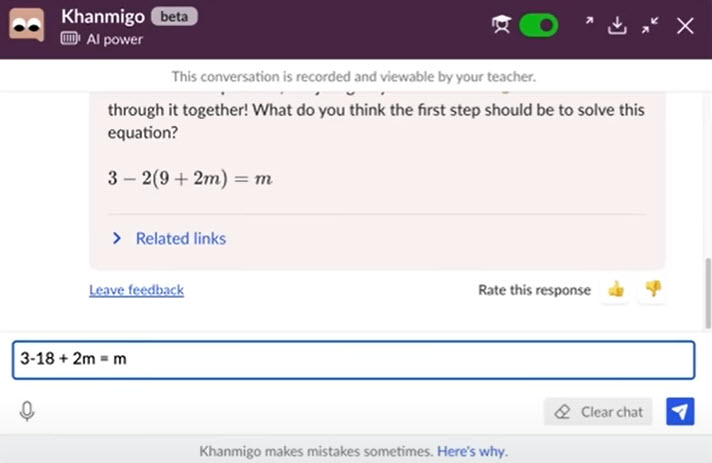

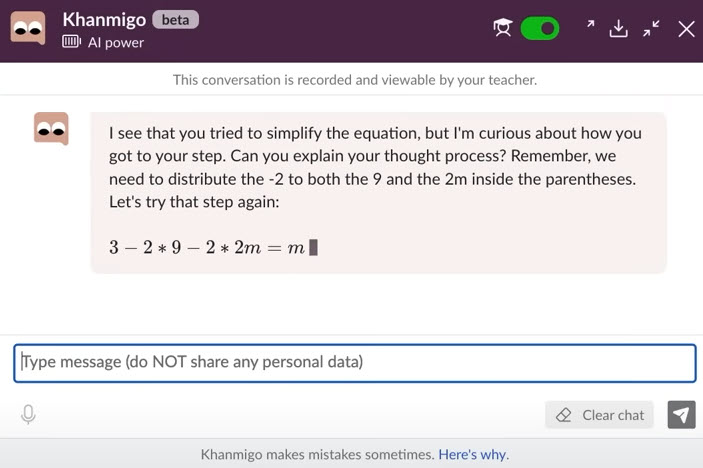

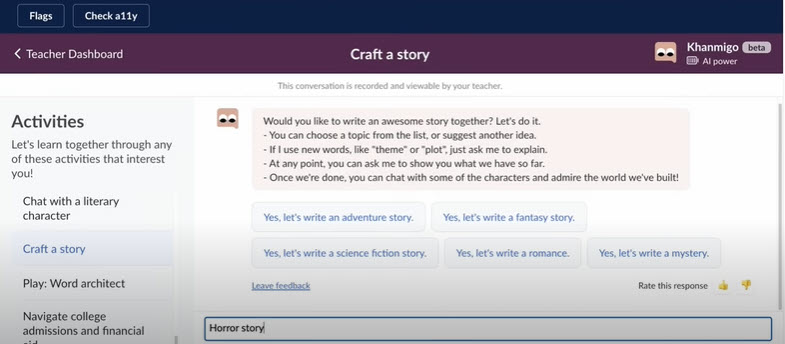

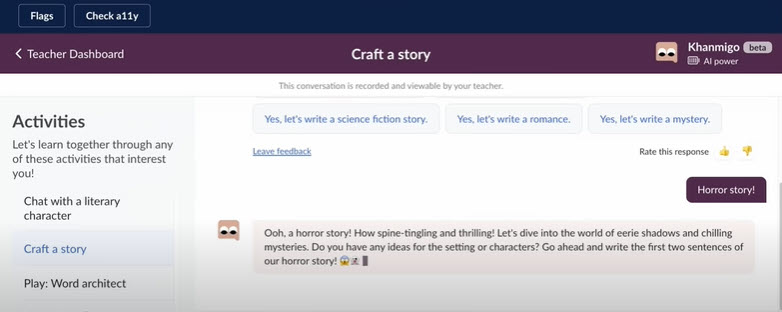

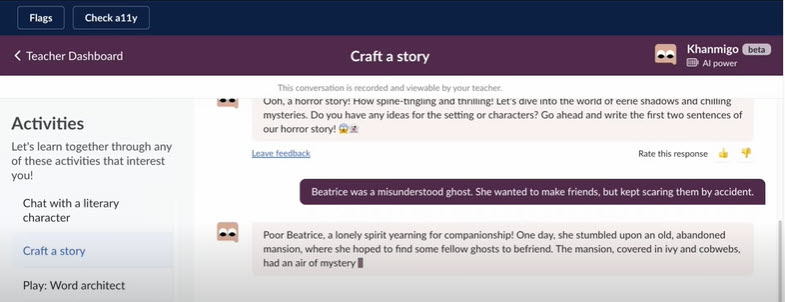

/md: Ein Bereich, der positiv hervorgehoben wird, ist die Bildung. Es wird darauf hingewiesen, dass diese Modelle dazu beitragen können, den Lernprozess zu verbessern, indem sie personalisierte Lerninhalte bereitstellen und Feedback geben. Darüber hinaus können sie auch bei der Erstellung von Lehrmaterialien und bei der Entwicklung von Sprachlern-Apps eingesetzt werden. Weitere Anwendungsbereiche, die diskutiert werden, sind unter anderem die Medizin, die Automobilindustrie und die Finanzbranche.

/md: Ein Bereich, der positiv hervorgehoben wird, ist die Bildung. Es wird darauf hingewiesen, dass diese Modelle dazu beitragen können, den Lernprozess zu verbessern, indem sie personalisierte Lerninhalte bereitstellen und Feedback geben. Darüber hinaus können sie auch bei der Erstellung von Lehrmaterialien und bei der Entwicklung von Sprachlern-Apps eingesetzt werden. Weitere Anwendungsbereiche, die diskutiert werden, sind unter anderem die Medizin, die Automobilindustrie und die Finanzbranche.

Gibt es Bereiche, die kritisch gestellt sind?

/md: Ja, ein Bereich, der kritisch betrachtet wird, ist die mögliche Verbreitung von Falschinformationen und die Manipulation von Menschen durch den Einsatz dieser Modelle. Es wird darauf hingewiesen, dass diese Modelle dazu verwendet werden können, gefälschte Texte und Nachrichten zu erstellen, die schwer von echten Texten zu unterscheiden sind. Ein weiterer kritischer Aspekt ist die mögliche Diskriminierung von bestimmten Gruppen durch diese Modelle. Wenn die Trainingsdaten nicht ausgewogen sind oder bestimmte Gruppen unterrepräsentiert sind, können diese Modelle dazu neigen, Vorurteile und Diskriminierung zu reproduzieren.

/md: Ja, ein Bereich, der kritisch betrachtet wird, ist die mögliche Verbreitung von Falschinformationen und die Manipulation von Menschen durch den Einsatz dieser Modelle. Es wird darauf hingewiesen, dass diese Modelle dazu verwendet werden können, gefälschte Texte und Nachrichten zu erstellen, die schwer von echten Texten zu unterscheiden sind. Ein weiterer kritischer Aspekt ist die mögliche Diskriminierung von bestimmten Gruppen durch diese Modelle. Wenn die Trainingsdaten nicht ausgewogen sind oder bestimmte Gruppen unterrepräsentiert sind, können diese Modelle dazu neigen, Vorurteile und Diskriminierung zu reproduzieren.

Welche möglichen Auswirkungen haben diese Modelle auf die Gesellschaft und wie können negative Folgen vermieden werden?

: Das Hintergrundpapier diskutiert verschiedene mögliche Auswirkungen von ChatGPT und anderen Computermodellen zur Sprachverarbeitung auf die Gesellschaft. Einige dieser Auswirkungen sind positiv, wie zum Beispiel die Verbesserung des Lernprozesses oder die Unterstützung von medizinischen Diagnosen. Es gibt jedoch auch mögliche negative Auswirkungen, wie zum Beispiel die Verbreitung von Falschinformationen oder die Diskriminierung bestimmter Gruppen. Um negative Folgen zu vermeiden, schlägt das Hintergrundpapier verschiedene Maßnahmen vor. Zum Beispiel wird betont, dass es wichtig ist, die Verwendung dieser Modelle transparent und nachvollziehbar zu gestalten und sicherzustellen, dass sie ethisch verantwortungsvoll eingesetzt werden. Es wird auch empfohlen, dass diese Modelle regelmäßig überprüft werden sollten, um sicherzustellen, dass sie nicht diskriminierend sind oder Falschinformationen verbreiten. Darüber hinaus wird betont, dass weitere Forschung notwendig ist, um die Auswirkungen dieser Modelle auf die Gesellschaft besser zu verstehen und um mögliche negative Folgen zu vermeiden. Es wird empfohlen, dass Regulierungsbehörden und andere Interessengruppen zusammenarbeiten sollten, um sicherzustellen, dass diese Modelle verantwortungsvoll eingesetzt werden und um mögliche Risiken zu minimieren.

: Das Hintergrundpapier diskutiert verschiedene mögliche Auswirkungen von ChatGPT und anderen Computermodellen zur Sprachverarbeitung auf die Gesellschaft. Einige dieser Auswirkungen sind positiv, wie zum Beispiel die Verbesserung des Lernprozesses oder die Unterstützung von medizinischen Diagnosen. Es gibt jedoch auch mögliche negative Auswirkungen, wie zum Beispiel die Verbreitung von Falschinformationen oder die Diskriminierung bestimmter Gruppen. Um negative Folgen zu vermeiden, schlägt das Hintergrundpapier verschiedene Maßnahmen vor. Zum Beispiel wird betont, dass es wichtig ist, die Verwendung dieser Modelle transparent und nachvollziehbar zu gestalten und sicherzustellen, dass sie ethisch verantwortungsvoll eingesetzt werden. Es wird auch empfohlen, dass diese Modelle regelmäßig überprüft werden sollten, um sicherzustellen, dass sie nicht diskriminierend sind oder Falschinformationen verbreiten. Darüber hinaus wird betont, dass weitere Forschung notwendig ist, um die Auswirkungen dieser Modelle auf die Gesellschaft besser zu verstehen und um mögliche negative Folgen zu vermeiden. Es wird empfohlen, dass Regulierungsbehörden und andere Interessengruppen zusammenarbeiten sollten, um sicherzustellen, dass diese Modelle verantwortungsvoll eingesetzt werden und um mögliche Risiken zu minimieren.